Intelligence artificielle : l’enseignement supérieur au défi de former des générations d’étudiants

En ordre dispersé, les cursus universitaires tentent d’intégrer l’intelligence artificielle pour enseigner aux étudiants un usage responsable de ces technologies dans leur futur domaine professionnel.

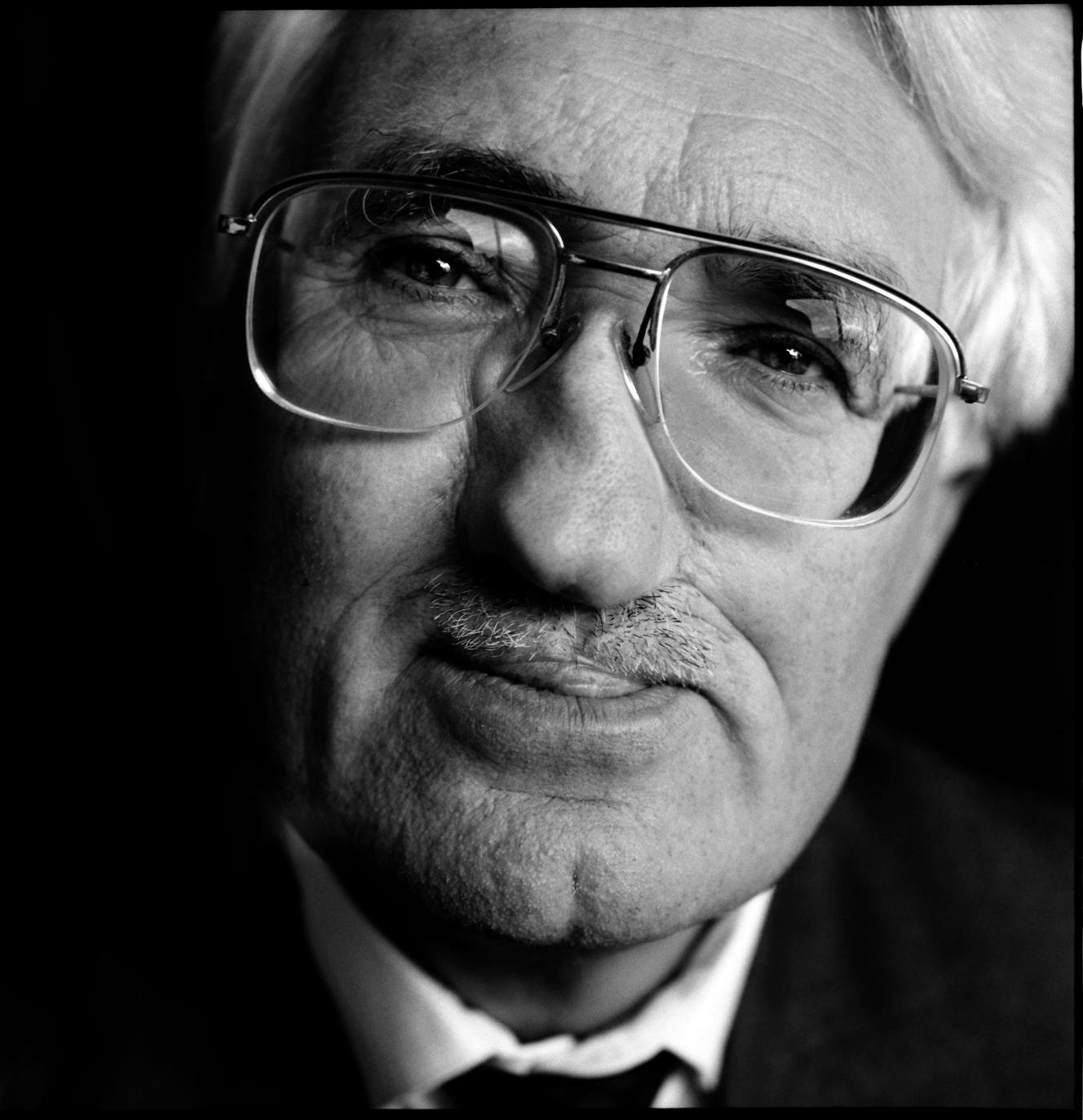

« L’éducation doit viser à former des êtres humains de premier ordre, et non des robots de second ordre. » Lorsque Andreas Schleicher prononce cette phrase, en mai 2019, nous sommes près de trois ans avant le lancement de ChatGPT, et le directeur de l’éducation à l’Organisation de coopération et de développement économiques (OCDE) pressent la complexité des enjeux qui guettent l’enseignement supérieur.

Remplacer les humains ou les « augmenter » ? Tel un Janus, l’intelligence artificielle (IA) présente deux faces, qu’universités et grandes écoles doivent appréhender avec doigté. Leur mission : former des étudiants, dans toutes les disciplines, pour qu’ils aient un usage responsable et adapté de ces technologies dans leur futur domaine professionnel.

Depuis le rapport du mathématicien et ancien député Cédric Villani, publié en mars 2018, la France s’est dotée d’une stratégie nationale pour l’IA. A travers des appels à projet, l’Etat mobilise actuellement quelque 2,5 milliards d’euros dans le cadre du plan France 2030 pour accélérer le développement de nouvelles formations ou l’adaptation de formations existantes aux besoins de compétences des nouvelles filières et des métiers dits « d’avenir ».

« L’enjeu n’est pas de rivaliser avec les machines sur leur propre terrain, mais de former des humains capables de rester pleinement humains dans un monde de machines intelligentes », a résumé François Germinet, professeur àCergy-Paris Université, lors d’un colloque sur les compétences et les savoirs à l’Institut des hautes études de l’éducation et de la formation, le 20 janvier.

Pour M. Germinet, ancien directeur du pôle connaissances du secrétariat général pour l’investissement – instance qui définit la politique d’investissement de l’Etat –, nous faisons face au défi « d’inventer la grande école du XXIᵉ siècle », « après les écoles d’ingénieurs du XVIIIᵉ siècle, les écoles de commerce du XIXᵉ et les sciences politiques du XXᵉ ». De nouvelles compétences deviennent capitales : « Développer jugement, sens, créativité, compréhension profonde et capacité d’apprentissage continu, et rééquilibrer savoirs académiques et expériences sensibles », illustre-t-il.

« Des formations très transverses »

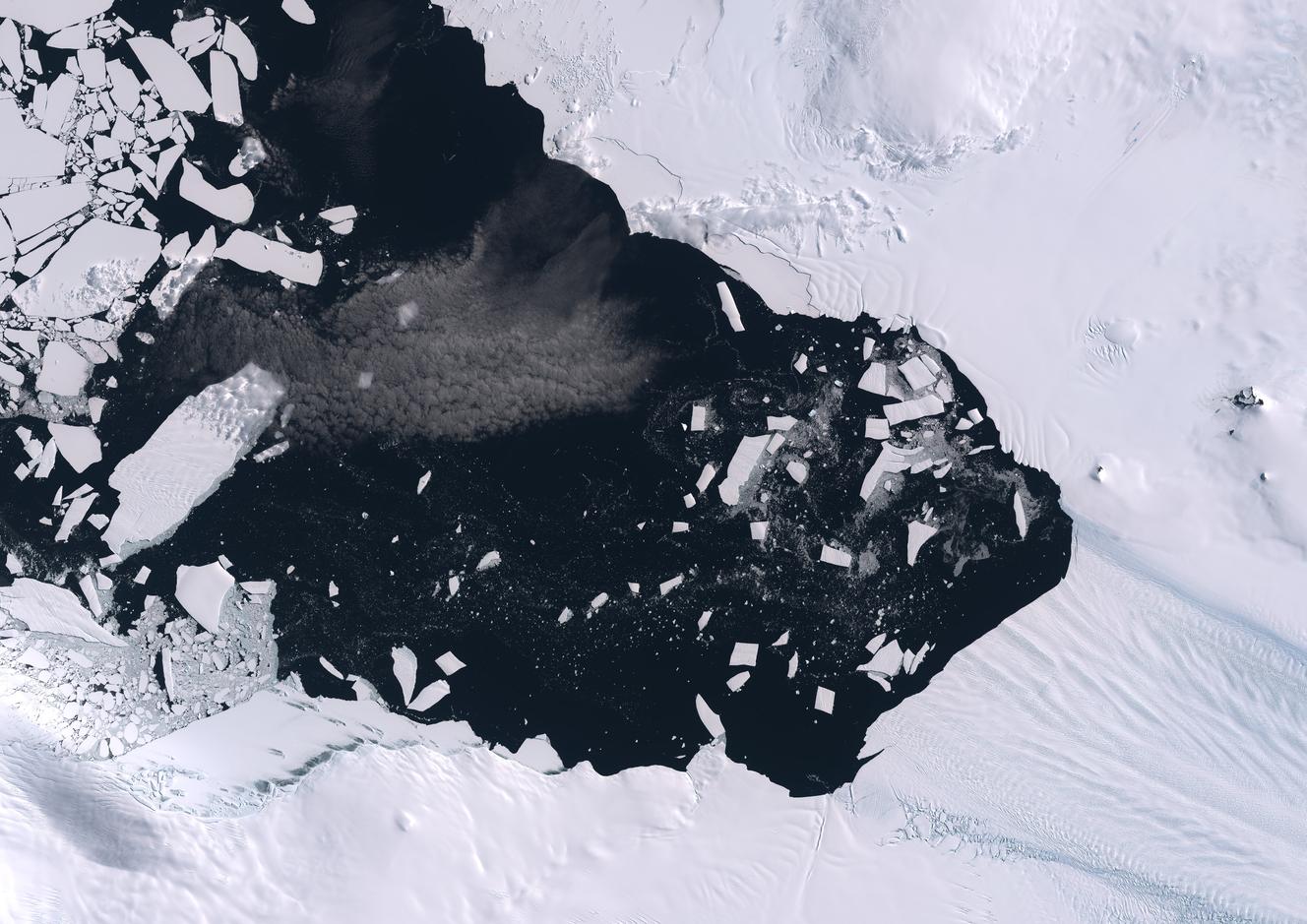

L’IA, dont les premiers travaux de recherche remontent à 1957, n’est pas exactement une nouvelle venue dans l’enseignement supérieur, tout particulièrement dans les sciences dures. Les progrès récents sont immenses, comme en bio-informatique, où l’intelligence artificielle permet d’explorer de nouvelles méthodes pour déterminer la structure tridimensionnelle d’une protéine, ce qui a des applications pratiques en médecine.

« Dans les écoles d’ingénieurs, les formations en IA datent d’il y a plusieurs dizaines d’années. Elles ont suivi les évolutions technologiques des réseaux de neurones ou du machine learning », souligne aussi Amandine Duffoux, directrice du campus Arts et Métiers d’Angers, responsable de la stratégie numérique à la Conférence des grandes écoles. Les élèves apprennent par exemple à développer des modèles de maintenance prédictive capables de détecter, grâce à des calculs, des signaux faibles révélant l’usure d’un composant.

En revanche, « les écoles de management avaient laissé ce champ de côté, souligne Mme Duffoux. Elles sont clairement en train de rattraper leur retard en créant des modules, par exemple en business intelligence » – technologies d’optimisation de la prise de décision grâce à l’intégration et à l’analyse fine de l’information.

La nouveauté résulte d’une prise de conscience que « cette technologie touche tous les domaines, et qu’il est nécessaire de mettre en place des formations très transverses, expose la docteure en informatique Isabelle Ryl, qui supervise la nouvelle Paris School of AI, ouverte à la rentrée 2025, à l’université Paris Sciences et lettres (PSL). C’est bien de vouloir mettre tout le monde à l’IA, mais, pour cela, il faut des enseignants, et on ne peut pas avoir une génération spontanée de chercheurs et de formateurs ». Sur la base du volontariat, des enseignants de toutes les disciplines à PSL ont suivi une formation intensive équivalente à un master et se sont engagés à construire un cours intégrant l’IA dans leur domaine.

A l’université Paris-I Panthéon-Sorbonne, la professeure de droit Célia Zolynski mène des auditions de représentants des professions juridiques et judiciaires « pour comprendre les besoins et développer des pratiques pédagogiques adaptées, dans un secteur où l’offre des entreprises de la Big Tech est très forte ». Elle pilote le programme AISorb, qui prévoit notamment de former les étudiants aux grands principes des technologies d’IA et à leurs enjeux sociaux et environnementaux. Il s’agit d’en faire des « tiers instruits » – tels qu’imaginés par le philosophe Michel Serres – sachant se nourrir des humanités et des sciences pour s’adapter aux évolutions du monde.

Dès la première année de licence, Mme Zolynski pose la question de la construction du droit : « Je cherche à développer le raisonnement juridique des étudiants à partir de leurs propres usages des réseaux sociaux, des deepfakes [hypertrucages], de l’intelligence artificielle générative [comme ChatGPT et ses équivalents]. Comment le droit encadre-t-il ces usages ? Quelles sont les insuffisances ? C’est plus intéressant que de livrer un cours magistral de manière verticale. »

« Nous voyons arriver des cohortes de lycéens habitués à utiliser l’intelligence artificielle générative dans leur quotidien sans s’être demandé quelles données ils divulguent en rédigeant leurs prompts [requêtes par écrit] », complète Hélène Bouraïma-Lelong, vice-présidente de l’université de Caen, où un module de sensibilisation deviendra obligatoire dans toutes les disciplines en 2028.

Données américaines ou chinoises

Avec son BrevetAI, un jeu vidéo dont la marque a été déposée, l’université Paris-Saclay espère former les 70 000 usagers de l’établissement, dont 50 000 étudiants. « Le jeu a été conçu par des designers, des ingénieurs pédagogiques, des développeurs, des professeurs et des étudiants de différentes disciplines, détaille Frédéric Pascal, vice-président de Paris-Saclay et auteur, avec le chercheur François Taddei, d’un rapport sur l’IA et l’enseignement supérieur, en juillet 2025. On part de ce qu’est un algorithme, de ce qu’on en fait et de ce que sont des données biaisées. Les chapitres suivants abordent l’impact environnemental de l’IA et les questions éthiques, avec une intervention de la CNIL [Commission nationale de l’informatique et des libertés]. Il s’agit d’une première réponse dans toutes les disciplines que nous allons déployer aussi à Sciences Po, à l’université Paris Cité, à l’université Dauphine-PSL et à l’international, notamment au Québec. »

« A ce stade, il est compliqué d’établir un paysage national des formations déployées, mais un travail de recensement est en cours de la part du ministère, indique Olivier Wong-Hee-Kam, qui préside l’association des vice-présidents d’université chargés du numérique. Notre objectif n’est pas de diffuser l’IA de façon aveugle, mais de former des personnes qui seront capables de la développer, en tenant compte des limites environnementales et éthiques qu’elle pose, afin de l’utiliser à sa juste valeur. »

De toutes les IA, l’intelligence artificielle générative est celle qui pousse le plus les formateurs à s’interroger. Ce système particulier, auquel ont principalement recours les sciences humaines et sociales, est destiné à générer du texte, des images, des sons, des vidéos, sur la base de modèles de langage entraînés sur de vastes corpus de données.

« Beaucoup de cours ont été adaptés, notamment en géopolitique, souligne Amandine Duffoux, à la Conférences de grandes écoles. Car on sait que des modèles de langage sont entraînés sur des données américaines ou chinoises, ce qui fait que les réponses apportées sont orientées. Avoir la main sur le modèle de langage de ChatGPT, c’est avoir un pouvoir d’influence qui est juste gigantesque ! Vous pouvez ignorer une partie des données et gonfler la masse de celles qui vous intéressent. »

Sous des atours « éthiquement neutres », l’IA est « toujours entre les mains de personnes qui ne le sont pas », avait déjà alerté Andreas Schleicher, de l’OCDE, dans son intervention en 2019.

[Source: Le Monde]