L’IA, des « outils incroyables » pour les personnes en situation de handicap

Les innovations permises par l’intelligence artificielle peuvent faciliter le quotidien, notamment pour les personnes présentant des déficits sensoriels, comme la surdité ou la cécité.

« Pièce lumineuse, avec de hautes fenêtres et une grande table au centre. Au fond, il y a un grand miroir et une cheminée. Un ordinateur portable ouvert est posé sur la droite de la cheminée. » La voix de ChatGPT, que Thibaut de Martimprey a activé sur son smartphone, lui donne un aperçu du salon dans lequel il vient d’entrer. Malvoyant, il a simplement pris une photo pour obtenir une description orale quasi instantanée. « Je l’utilise beaucoup au quotidien. C’est intuitif : j’ouvre la caméra et je demande par exemple quelle est la date de péremption d’une boîte de chocolats. »

Le directeur du campus Louis-Braille, un incubateur de start-up consacré à la déficience visuelle, utilise très souvent son téléphone, notamment pour la lecture audio (Voice Over) ou la description de son environnement, grâce à ChatGPT ou Be My Eyes, une application danoise d’intelligence artificielle (IA) téléchargée par 900 000 personnes dans le monde.

« L’appli décrit l’image et répond aux questions qu’on lui pose. Ou bien, on peut appeler un bénévole francophone, en visio pour une aide. Je viens de le faire, pour savoir pourquoi un voyant de ma cafetière clignotait. C’est plus “secure” que ChatGPT, qui fait parfois des erreurs. » Cette application a aussi une vision sélective : lors de sa description, elle n’avait pas repéré la peluche grise posée sur la cheminée.

Canne connectée

« Ces outils sont incroyables, l’enjeu est de faire le tri », estime M. de Martimprey. Le campus Braille, à Paris, accompagne des entreprises qui se lancent dans des innovations technologiques répondant à divers besoins : une canne connectée qui prévient des obstacles, des plans tactiles et vocaux pour se repérer dans un bâtiment, une application de guidage dans les transports, des casques ou tablettes en relief pour suivre des événements sportifs ou bien une ceinture haptique, connectée à une minicaméra accrochée à des lunettes, qui retranscrit par impulsions au niveau des lombaires la perception spatiale de l’environnement. Après huit ans de développement, la ceinture Artha devrait être commercialisée au début de 2026. « Ce projet n’aurait pas été possible sans IA », assure la directrice générale d’Artha France, Alix Pradère.

Le handicap visuel n’est pas le seul secteur à bénéficier de progrès technologiques dans la vie de tous les jours. « L’IA a fait plus pour la surdité que quarante ans de législation », assure Virginie Delalande, conférencière et coach en entreprise. Sourde profonde, elle lit sur les lèvres et s’exprime avec aisance à l’oral, mais cela lui demande beaucoup d’énergie, et elle apprécie de pouvoir compter sur des logiciels de transcription, ou des applications d’accessibilité sur son smartphone. « J’ai sur mon portable une application qui m’envoie un message quand elle reconnaît le bruit de la sonnette ou les aboiements de mon chien. » Autre difficulté récurrente : « Quand on est sourds, le téléphone, c’est très compliqué. Je passe par l’application Rogervoice qui sous-titre les conversations en temps réel et qui est très efficace. »

L’entreprise, créée en 2014, permet aux personnes sourdes et malentendantes de téléphoner, en sous-titrant les appels dans une centaine de langues. « La reconnaissance vocale, qui existe depuis très longtemps, c’est de l’intelligence artificielle. Mais aujourd’hui, elle est arrivée à maturité et elle est époustouflante », explique son fondateur Olivier Jeannel, lui-même malentendant.

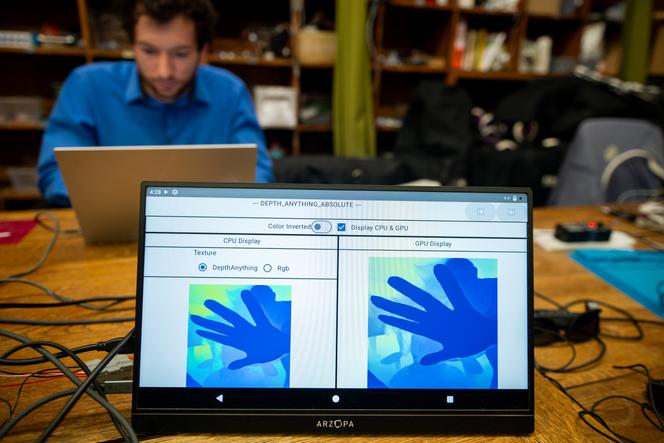

Pour plus de précisions sur le ton de l’interlocuteur, les bruits extérieurs ou les termes techniques, un intervenant humain peut être sollicité. Et l’autre service de Rogervoice, la traduction d’appels en langue des signes française (LSF), reste entièrement réalisé par des interprètes humains, faute de solution technique satisfaisante. Pour Olivier Jeannel, avant de pouvoir dialoguer en LSF avec une intelligence artificielle, « les défis sont considérables. L’échantillon de population pour les bases de données est beaucoup plus faible, et la captation visuelle est compliquée (contrejour, rapidité, qualité d’image…) ».

Comprendre et interagir

Malgré les progrès considérables de l’IA, la langue des signes reste très compliquée à retranscrire de manière automatique, hormis pour émettre des messages simples. C’est le constat qu’a aussi fait Thibault Duchemin, un ingénieur franco-américain basé en Californie. Il y a dix ans, au début de sa vie professionnelle, le jeune homme entendant, mais issu d’une famille sourde, a cherché à créer un gant pour interpréter en LSF, « mais toutes les solutions ont fait pschitt ». Il se méfie des « effets d’annonce » d’avatars capables de parler en LSF et a préféré concentrer ses recherches sur le sous-titrage de la voix. « On a réussi parce qu’on n’est pas partis de la technologie, mais des besoins. »

AVA, l’application qu’il a cofondée, transcrit les conversations de groupes, de manière automatique ou avec une relecture humaine, selon le degré de précision nécessaire, pour permettre aux malentendants de comprendre et d’interagir, dans des situations comme les dîners ou les réunions professionnelles où ils se retrouvent souvent exclus. L’entreprise s’est développée grâce à l’essor du télétravail post-Covid-19.

Si les déficiences sensorielles sont historiquement les premières applications de l’intelligence artificielle, sa puissance de calcul et ses capacités d’apprentissage fournissent désormais des réponses adaptées à une grande diversité de handicaps, y compris invisibles. Sébastien Vermandel, responsable veille et conseil au TechLab d’APF France handicap, recense ces innovations et publie des fiches techniques détaillées sur Internet. Certaines solutions présentées sont des applications gratuites ou simples d’accès. Ainsi, Microsoft Seeing AI, à l’origine destinée aux déficients visuels, aide toutes les personnes qui peinent à lire, en raison de troubles cognitifs ou du neurodéveloppement.

Pallier une dyslexie

Plusieurs logiciels d’IA générative, qui créent ou réécrivent des textes, sont très utilisés dans le milieu professionnel pour pallier une dyslexie ou une dysorthographie. Le site Goblins.tools a étendu ces usages, en créant une série d’outils pour analyser le ton et les sous-entendus d’un texte – un défi pour les personnes présentant des troubles du spectre autistique –, corriger un message écrit avant de l’envoyer, ou décomposer des tâches complexes en listes d’actions détaillées – un usage très prisé des personnes touchées par des troubles du déficit de l’attention.

Dans le domaine du langage, des projets sont aussi lancés pour transcrire de manière automatique les textes complexes en des versions facile à lire et à comprendre (FALC), à destination des personnes ayant des troubles cognitifs. Pour y parvenir, l’IA doit d’abord être entraînée sur des bases de textes existants, un corpus qui reste assez confidentiel, car il n’est produit que par des travailleurs handicapés dans des établissements d’aide par le travail.

D’autres innovations qui paraissaient relever de la science-fiction il y a quelques années deviennent réalité, comme rendre à quelqu’un la voix qu’il a perdue, avec une synthèse vocale s’appuyant sur des enregistrements plus anciens, ou sur les timbres de voix des proches. « Il y a des progrès fantastiques, mais énormément de limites, nuance M. Vermandel. La voix “naturelle” fonctionne seulement avec une connexion Internet, ou sous forme de forfait. Ce qui fait penser à [la série] Black Mirror où, quand on ne paie pas de supplément, on est contraints à avoir une voix de seconde zone. » Lorsque l’on dépasse le simple usage d’applications sur smartphone, les obstacles financiers restent souvent un frein aux usages de l’IA, alors que 19,5 % des adultes en situation de handicap vivent sous le seuil de pauvreté.

Comme pour toute révolution technologique, l’intelligence artificielle suscite des craintes. En premier lieu, celle d’une mise à l’écart des personnes en situation de handicap. « La question de l’inaccessibilité se pose à deux niveaux : le coût financier de certains objets ou abonnements, et la maîtrise fine de certains outils, assez techniques, dont certaines personnes en situation de handicap n’arrivent pas à s’emparer », Farbod Khansari, conseiller national APF France handicap et délégué général du Conseil français des personnes handicapées pour les affaires européennes et internationales (CFHE).

Cet organisme a publié en avril un rapport intitulé « Handicap et intelligence artificielle, potentiel, risques et défis », qui souligne d’autres points de vigilance, comme les risques de discrimination « en raison d’algorithmes basés sur des moyennes statistiques, auxquelles [les personnes en situation de handicap] peuvent ne pas s’adapter ». La « boîte noire » des logiciels filtrant des CV ou déterminant l’éligibilité à un prêt bancaire peut amener à rejeter les dossiers qui diffèrent de la norme. Quant aux bases de données utilisées pour entraîner l’IA, si elles n’intègrent pas les handicaps, elles risquent de conduire à des diagnostics erronés en matière de santé ou de considérer des personnes comme « indignes de confiance » à partir de la reconnaissance faciale.

Jérémie Boroy, président du Conseil national consultatif des personnes handicapées, appelle à « intégrer les questions d’accessibilité et d’autonomie » dans toutes les politiques publiques et tous les sujets liés à l’IA et à systématiquement« consulter les personnes concernées ».

[Source: Le Monde]